作业二 深度学习基础

视频学习心得

内容笔记

1.深度学习应用

已经深入:特征提取,物体检测,语义标注;

有待解决:描述生成:多媒体问答,多媒体叙事。

2.深度学习的当前弱点:

a.算法输出稳定性差。改变图像某个像素,输出就会被影响。

b.模型复杂度低,难以纠错和调试。无意义输出倾向于给出一个有意义输出。(Google毛利语翻译英语,采用圣经语调。)

c.模型层级复合程度高,参数不透明。

d.端到端的训练模式对数据依赖性强,模型增量性差。(只有数据量大到一定的程度,才能 语义标注+关系检测=图像描述)

e.专注直观感知问题,对开放性推理问题无能为力。(鹦鹉智能,乌鸦智能(乌鸦喝水,乌鸦马路坚果),奥巴马大象民主党(隐喻))

f.无法引入人类监督,机器偏见难以避免。(种族歧视,联想偏见,语调偏激,COMPAS评估犯罪风险,违反社会伦理)

(阿西莫夫机器人三定律:1.机器人不得伤害人类,或者坐视人类受到伤害;2.除非违背第一法则,否则机器人必须服从人类命令;3.除非违背第一或者第二法则,否则机器人必须保护自己。)

3.连接主义与符号主义从对立到合作:

符号主义:逻辑结构,知识图谱。

联结主义:神经网络,深度学习。

4.深度神经网络的问题:梯度消失:增加深度造成梯度消失,误差无法传播;多层网络容易陷入局部极值,难以训练。

5.受限玻尔兹曼:

自编码器:输出等于输入,输入+隐层(最大程度代表原输入信号)+输出

最初降维

堆叠自编码器:

个人总结

神经网络采用了逻辑回归的思想,同时借以梯度下降法来应对损失函数的问题。向量化是训练大数据集的前提,考虑迟到GPU更加擅长SIMD计算,避免使用明确的for循环,从而提高代码速度。

问题描述

在自己试图设计模型的时候,怎么选择神经网络的层数,具体是三层还是四层?

代码实现

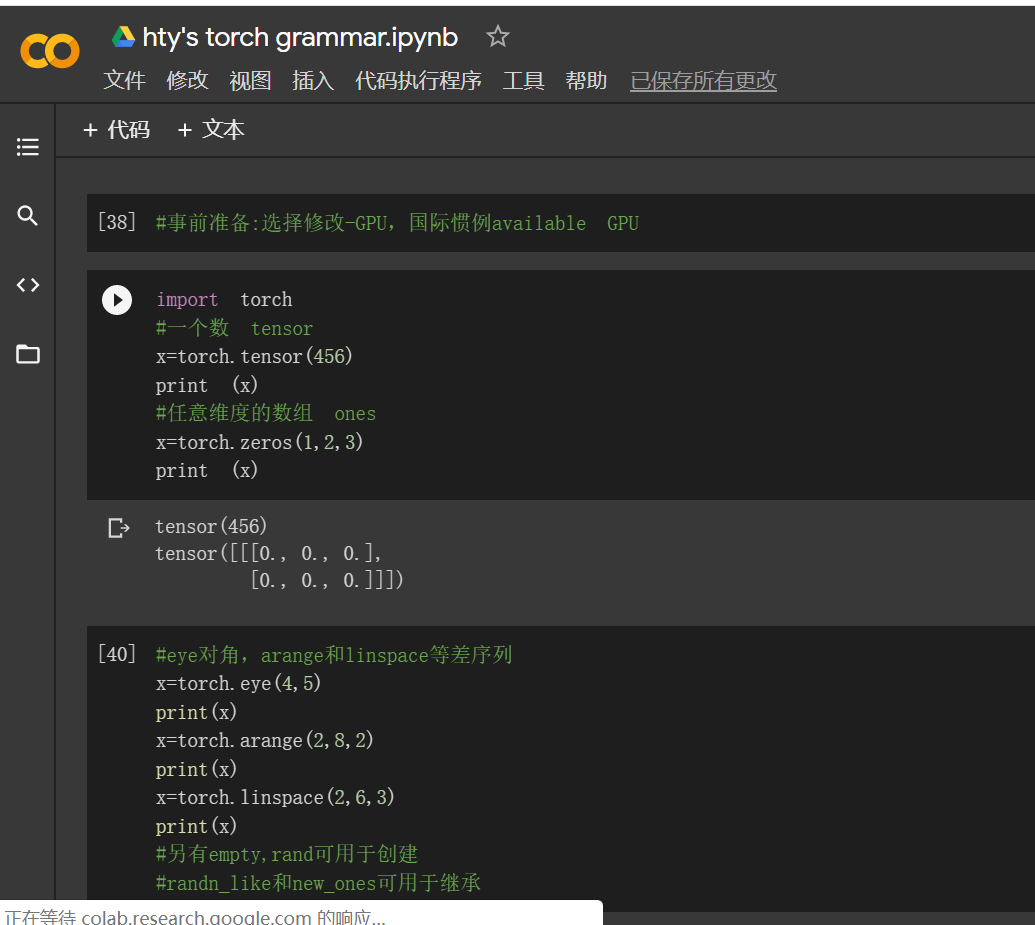

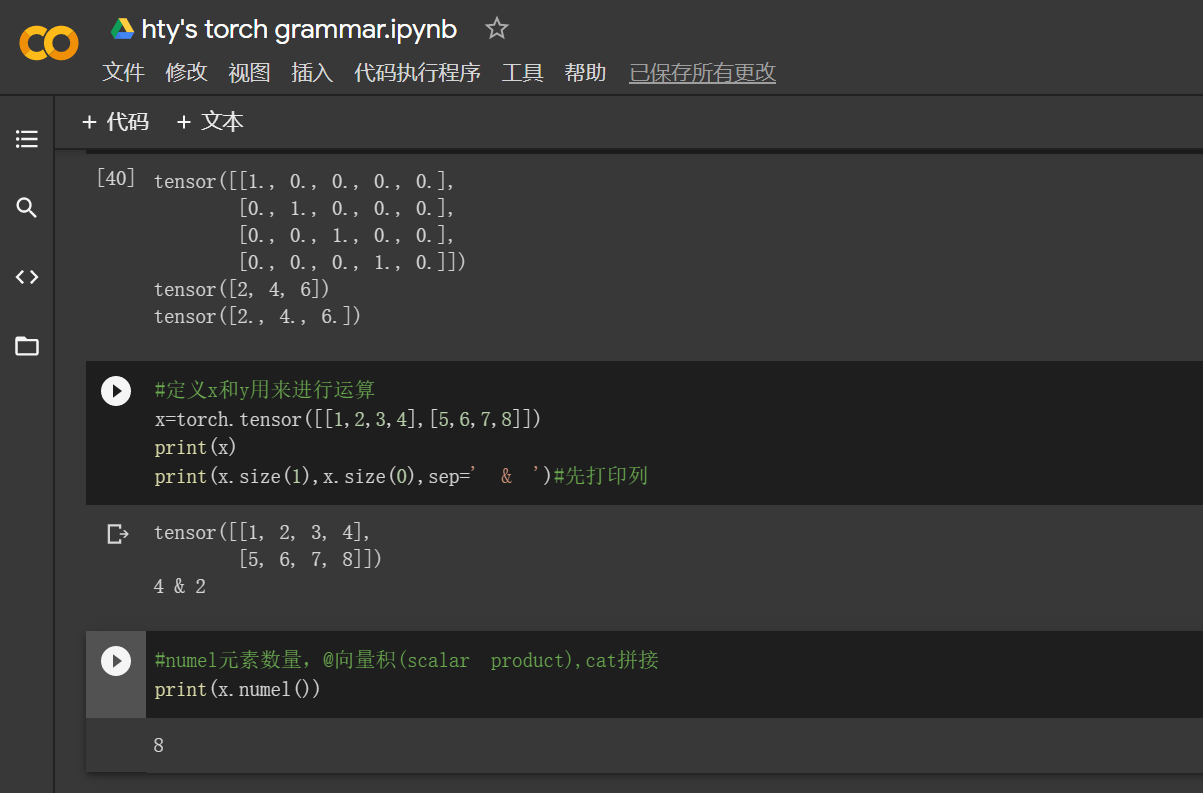

pytorch grammar

pytorch的基本语法,创建tensor并且有基本运算,从中可以感受到torch库的方便和人性化命名

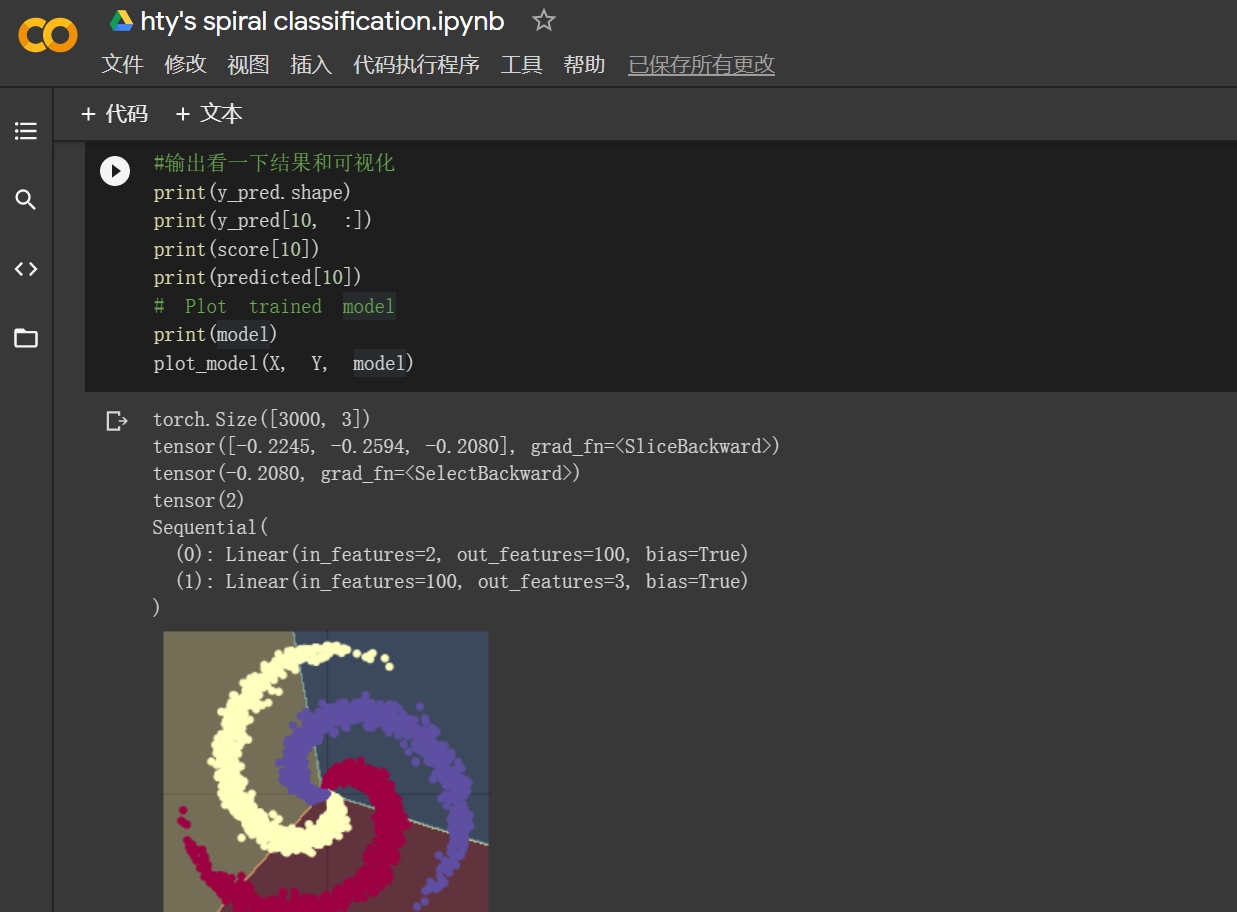

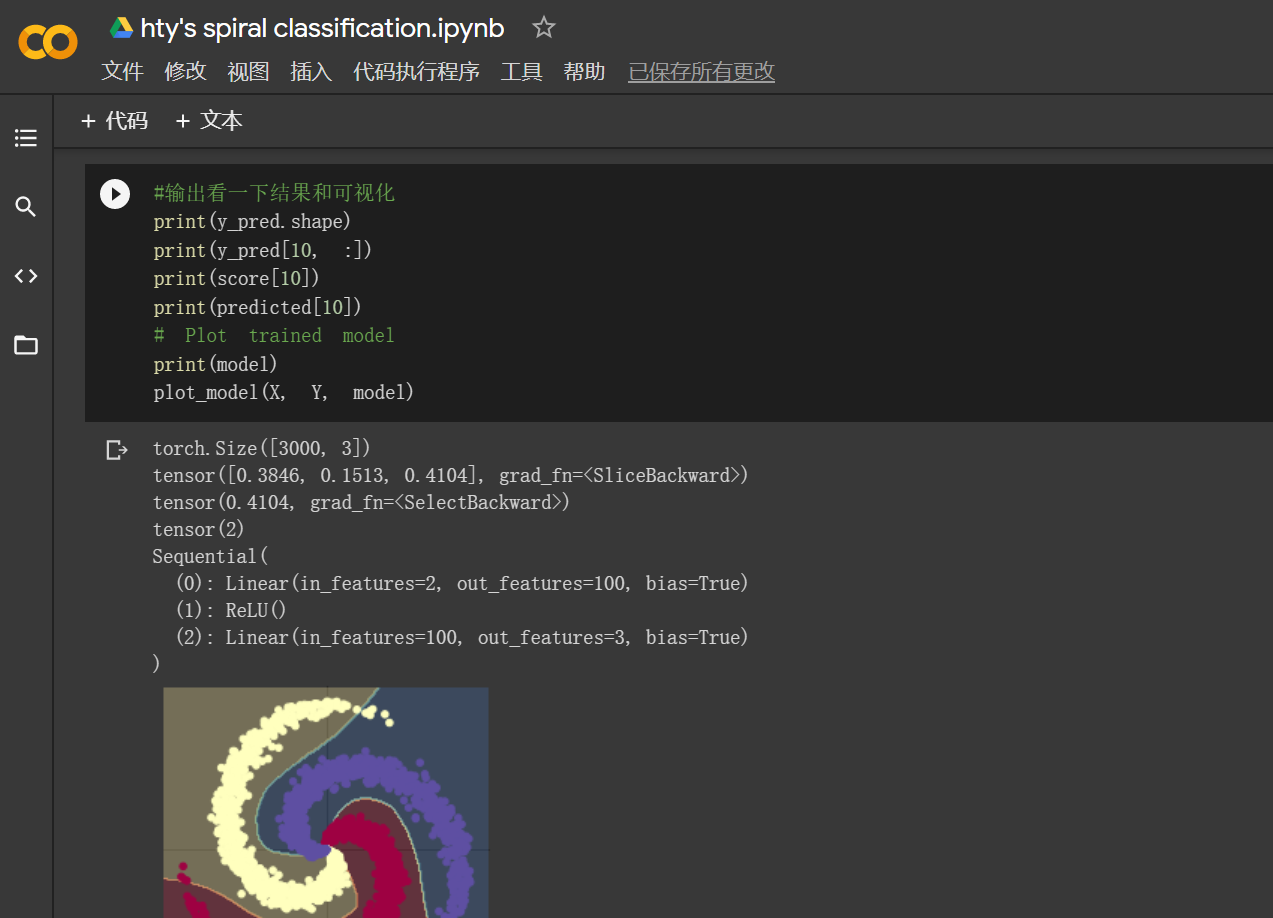

spiral classification

螺旋分类的代码实现,从中可以直观感受到ReLU单侧抑制,不存在梯度消失问题,使得模型的收敛速度维持在一个稳定状态。

浙公网安备 33010602011771号

浙公网安备 33010602011771号