End-to-end optimized image compression 阅读笔记

(暂不关注写作技巧和谋篇布局,前期主要针对相关知识进行学习。

2023.12.16 陈龙)

使用某种压缩方法,比JPEG更好的失真率。而且在所有比特率下视觉质量明显改善(MS-SSIM)

Introduction

- 数据压缩的目标是为给定数据集合设计熵最小的编码。在有限熵的条件下,连续数据必须量化为有限离散数据,这导致了误差(这就是所谓有损压缩问题)。在该问题中,就需要在“离散表示的熵rate”和“量化产生的误差distortion”之间权衡。

- 变换编码方法:1将数据向量线性变换为合适的连续表示2独立量化(离散化?)其元素3使用(无损)熵编码对离散表示进行编码。

- 例如JPEG 对像素块进行 离散余弦变换

- JPEG 2000 则使用 多尺度的正交小波分解

- 该文章提出基于非线性变换的端到端图像压缩优化框架。

![image]()

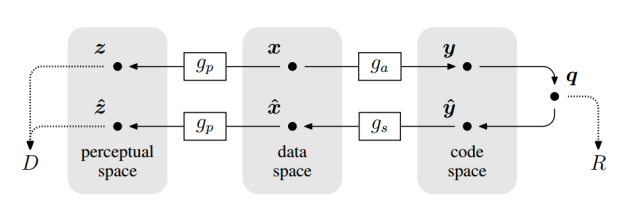

- 压缩:通过参数为 \(\phi\) 的函数(analysis变换)\(g_a(*)\),将\(x \in R^n\)映射到潜在码空间(latent code space)得到码域向量\(y = g_a(x,\phi)\) 然后对y量化,得到离散的向量\(q \in Z^M\),接着对q进行压缩,压缩的码率/比特率 R(rate)为量化向量q的离散概率分布\(P_q\)的熵作为下届。

- 解压缩:将q重新解释(reinterpreted)为连续值\(\hat{y}\),然后通过参数为\(\theta\)的分析变换(synthesis),\(g_s(*)\),将\(\hat{y}\)重新变换到数据域(data space),得到重构图像\(\hat{x}=g_s(x,\theta)\)

- 评估失真度(distortion)D:使用固定的变换\(g_p(*)\),将图形变换到感知空间进行对比,得到\(z=g_p(x)\)以及\(\hat{z}=g_p(\hat{x})\),然后用d(z,z~)来评估D

- 优化目标是R+\(\lambda D\) 用以优化参数\(\phi,\theta\)

choice of forward, inverse, and perceptual transforms

- 早期研究表明,在线性块加入局部归一化可提高编码性能,并提高级联卷积神经网络的物体识别性能。该研究针对任务进行优化,使用提出具有优化参数的GDN变换。(作者强调了GDN与深度学习中批量归一化的区别,归一化是将数据做仿射变换,而GDN则是空间自适应的,可以是高度非线性的)

- 具体实现:

-

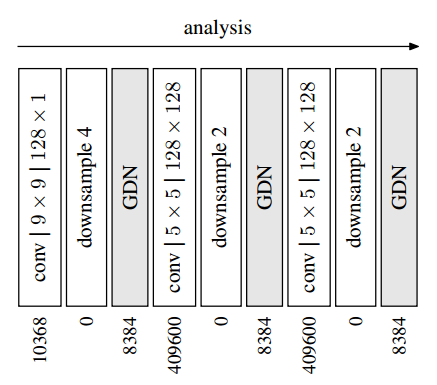

\(g_a\) 仿射卷积->下采样 -> 除法归一化(GDN) 见p3

![image]()

-

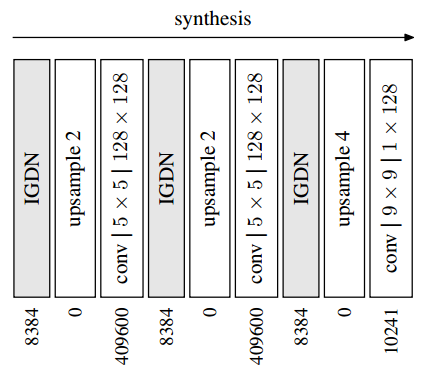

\(g_s\) 仿射卷积<-上采样 <- IGDN

![image]()

-

gp感知变换 使用某种恒等变换,并用均方误差做评价指标

-

optimization of nonlinear transform coding model

-

优化目标是最小化权重和(R+lamda*D),由于图形空间维度较高,直接进行优化比较难,因此在编码空间假设了一个固定的均衡标量量化器,对空间做非线性变换,实现向量量化的参数形式。用熵作为目标函数

-

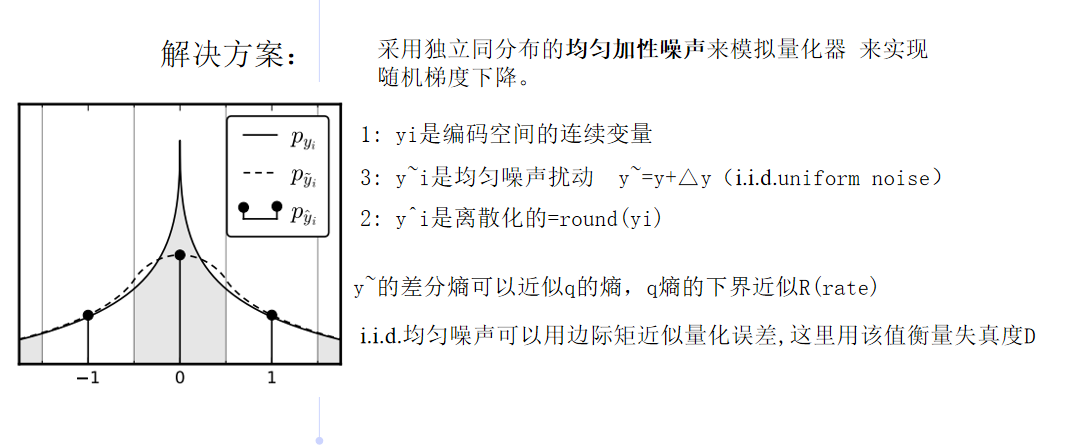

CNN训练过程要求损失函数对权重和偏置几乎处处可微量化后的离散变量不满足该要求,采用独立同分布的均匀加性噪声来模拟量化器 来实现随机梯度下降。(可以理解为,为了能够进行梯度下降,在网络训练过程中使用均匀噪声,而在压缩时使用量化器进行量化)

![image]()

-

均匀标量量化器(uniform scalar quantizer)是一个分段常数函数;其导数是不连续的(具体而言,它处处为零或无限),使得梯度下降无效。为了允许通过随机梯度下降进行优化,作者将量化器替换为附加量∆ y ∼ U ( 0 , 1 ) U:均匀分布,0为中心,1为范围)。

experimental results

- 以ImageNet的一个子集作为数据,使用随机下降,对参数进行联合优化。对每个lamda分别生产单独的变换和边际概率模型。

- 对灰度分析转换(应该是指ga),第一阶段使用128个滤波器(9*9),横向和纵向子采样率为4倍,另外两个阶段保留通道数,滤波器跨越所有输入通道,子采样系数为2,净输出是输入维度的一半。(对RGB图形。。。略)

- 对连续松弛损失函数近似量化得到实际rate-distortion,松弛失真项大多无偏,且偏差较小。

- 量化较粗时,松弛熵对离散上有一定的正偏差

- 量化较细时,这种偏差消失。

discussion

- 与线性变换的编码方式相比,这种分析变换可视为 一阶段的线性变化和一个复杂向量量化器

- 本文对话的文章:

- Gregor, Karol, Frederic Besse, et al. (2016). “Towards Conceptual Compression”. In: arXiv e-prints.arXiv: 1604.08772.

- Toderici, George et al. (2016). “Full Resolution Image Compression with Recurrent Neural Networks”. In: arXiv e-prints. arXiv: 1608.05148.

浙公网安备 33010602011771号

浙公网安备 33010602011771号