python定向爬虫实例(五)

功能描述;爬取B站的番剧排名信息

程序设计:

- 获取B站排名信息的HTML文本内容

- 解析HTML文本获取排名、番剧名称等信息

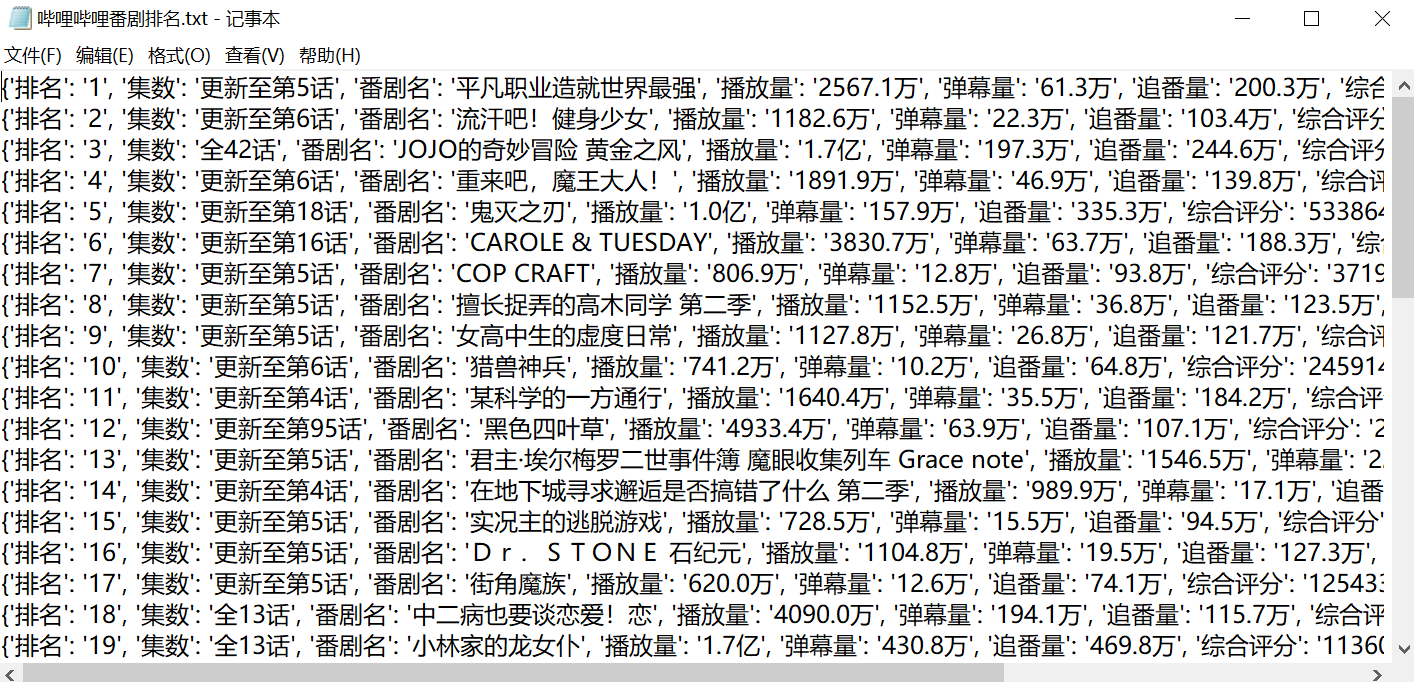

- 将获取到的信息存储到文件中

代码:

#爬取B站番剧排名等信息,并将排名信息存储到文件中 import requests,bs4 from bs4 import BeautifulSoup def getHTMLText(url): try: r=requests.get(url,headers={'User-Agent':'Mozilla/5.0'}) r.raise_for_status() r.encoding=r.apparent_encoding return r.text except: return "" def parseHTML(demo,file_path): soup=BeautifulSoup(demo,"html.parser") f=open(file_path,'w') for li in soup.find_all('li','rank-item'): info_dict={} try: rank=li.find('div','num').string #排名 info_div=li.find('div','info') count=info_div.find('div','bangumi-info').string #集数 data_span=info_div.find_all('span','data-box') #其他信息 #排名,集数,番剧名,播放量,弹幕量,追番量,综合得分 info_dict.update({ "排名":rank, "集数":count, "番剧名":info_div.find('a').string, "播放量":data_span[0].contents[1], "弹幕量":data_span[1].contents[1], "追番量":data_span[2].contents[1], "综合评分":info_div.find('div','pts').find('div').string, }) f.write(str(info_dict)+'\n') except: continue f.close() print("爬取完毕!") def main(): url='https://www.bilibili.com/ranking/bangumi/13/0/3' file_path="D://哔哩哔哩番剧排名.txt" #保存路径 demo=getHTMLText(url) parseHTML(demo,file_path) main()

效果:

浙公网安备 33010602011771号

浙公网安备 33010602011771号