搭建一个图片变视频的AI(一):模型介绍

在AI如火如荼发展的今天,让图片变视频的功能已经相当成熟了,很多AI软件都可以实现:上传一张图片,一段描述,就可以输出一个视频,实现了让一张图片动起来的效果。

今天教大家这么在自己的电脑上搭建一个:让图片变视频的AI根据(本内容需要有一定编程基础)

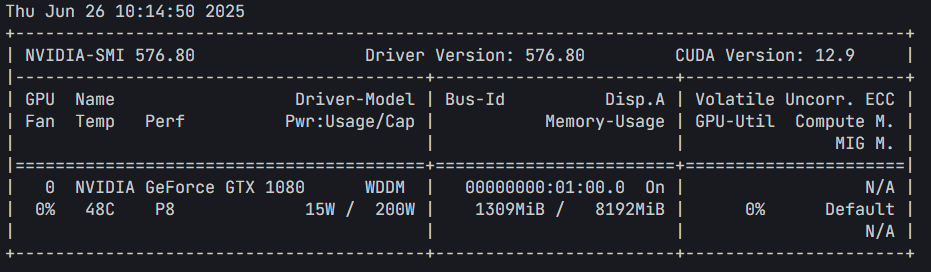

前期准备:特别注意,你的电脑如果GPU特别小,就不用考虑在本地搭建了,你不配~。

我的电脑GPU是专用8G,共享16G(可以不考虑,主要是专用GPU大小),这个配置一张图片生成视频(图片:914k,尺寸:576*1204,生成的视频3M,4s,8帧/s,尺寸576*1024)。

一运行,GPU就100%,结果跑了一晚上才成功。噗~~

一:本地环境:

window10电脑(GPU越大越好)。

Python 3.11.9。

CUDA Version: 12.9。(驱动支持的最大 CUDA 版本,之前版本太低了,下载个新的安装,升级,重新启动电脑)

特别注意:CUDA,后面安装torch相关时需要。

#查看 python python -V #查看显卡版本

nvidia-smi

二:开源代码下载:

ComfyUI:作为Stable Diffusion用户界面。

ComfyUI-DynamiCrafterWrapper: 作为为 ComfyUI 设计的自定义节点(Custom Node),它使得用户能够在 ComfyUI 的节点式工作流中轻松地集成和使用 DynamiCrafter 模型。

ComfyUI Manager:它可以被视为 ComfyUI 的**“插件商店”或“管理中心”**,极大地简化了 ComfyUI 的日常使用和维护。

下面是下载链接:

https://github.com/comfyanonymous/ComfyUI

https://github.com/kijai/ComfyUI-DynamiCrafterWrapper

https://github.com/Comfy-Org/ComfyUI-Manager

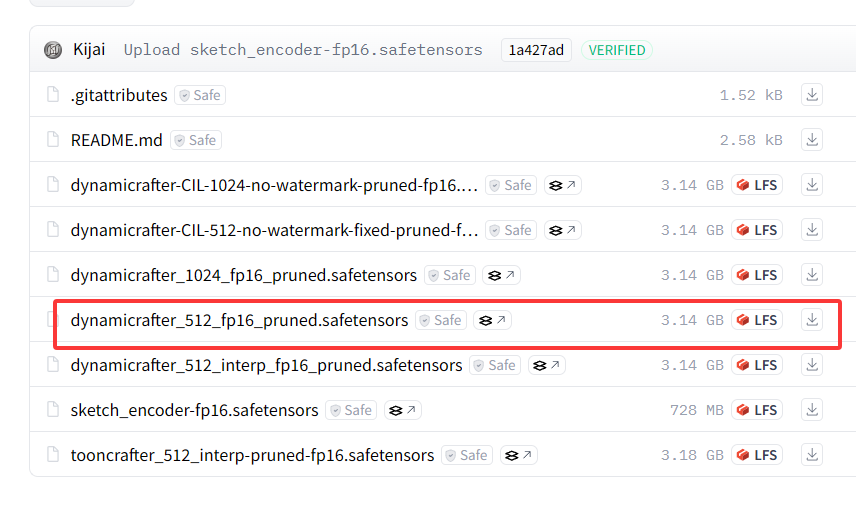

模型dynamicrafter我这里使用的是转换后的(比较小3G,原始的比较大10G),我下载使用的是 dynamicrafter_512_fp16_pruned.safetensors。

下面是模型选择链接:

https://huggingface.co/Kijai/DynamiCrafter_pruned/tree/main

如果你的电脑GPU相当不错,可以考虑原始模型10G。(下载里面的文件 model.ckpt,然后重命名:dynamicrafter_512_v1.ckpt)

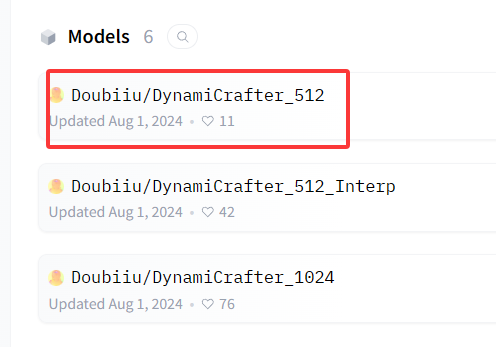

原始模型下载:https://huggingface.co/Doubiiu

浙公网安备 33010602011771号

浙公网安备 33010602011771号