【Python爬虫案例】用python爬1000条哔哩哔哩搜索结果

一、爬取目标

大家好,我是 @马哥python说 ,一名10年程序猿。

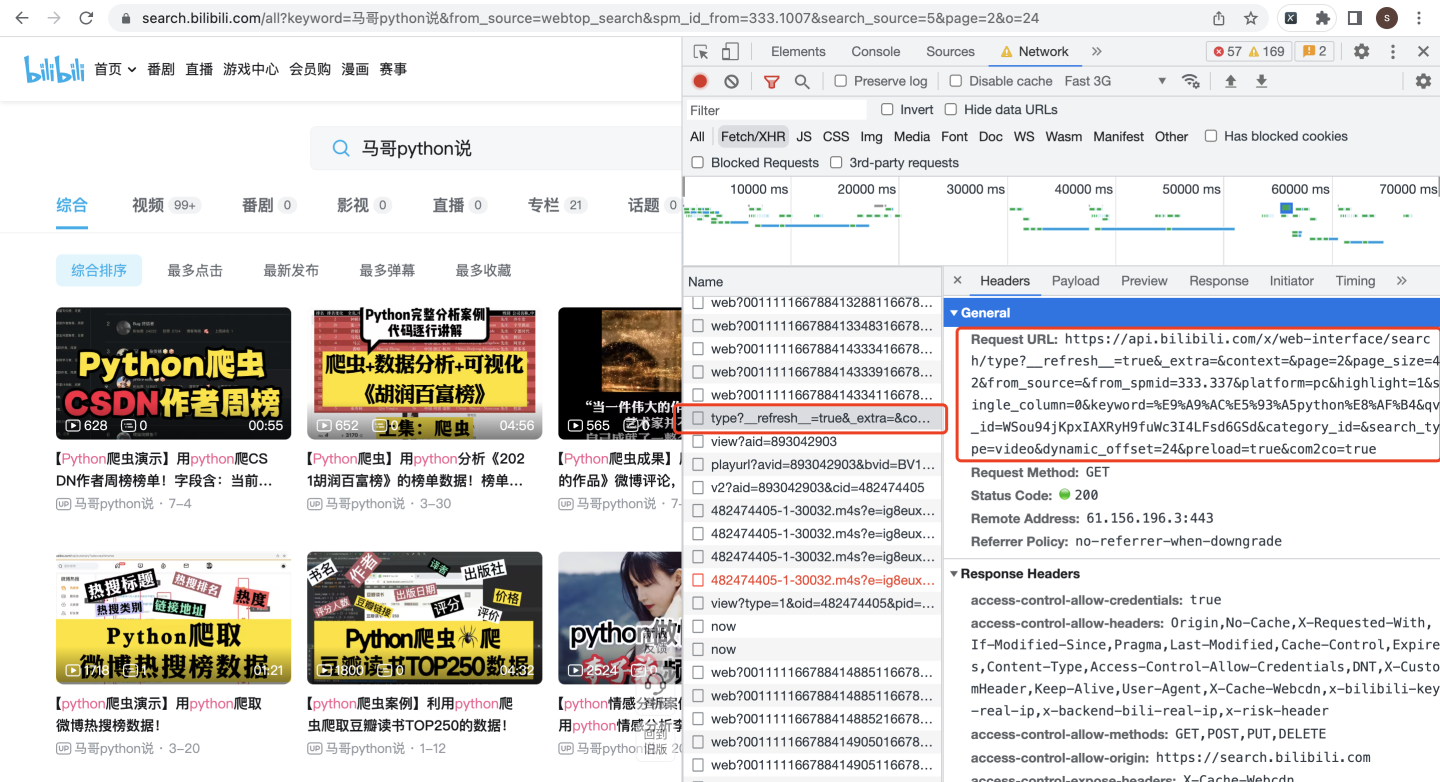

今天分享一期爬虫的案例,用python爬哔哩哔哩的搜索结果,也就是这个页面:

爬取字段,包含:

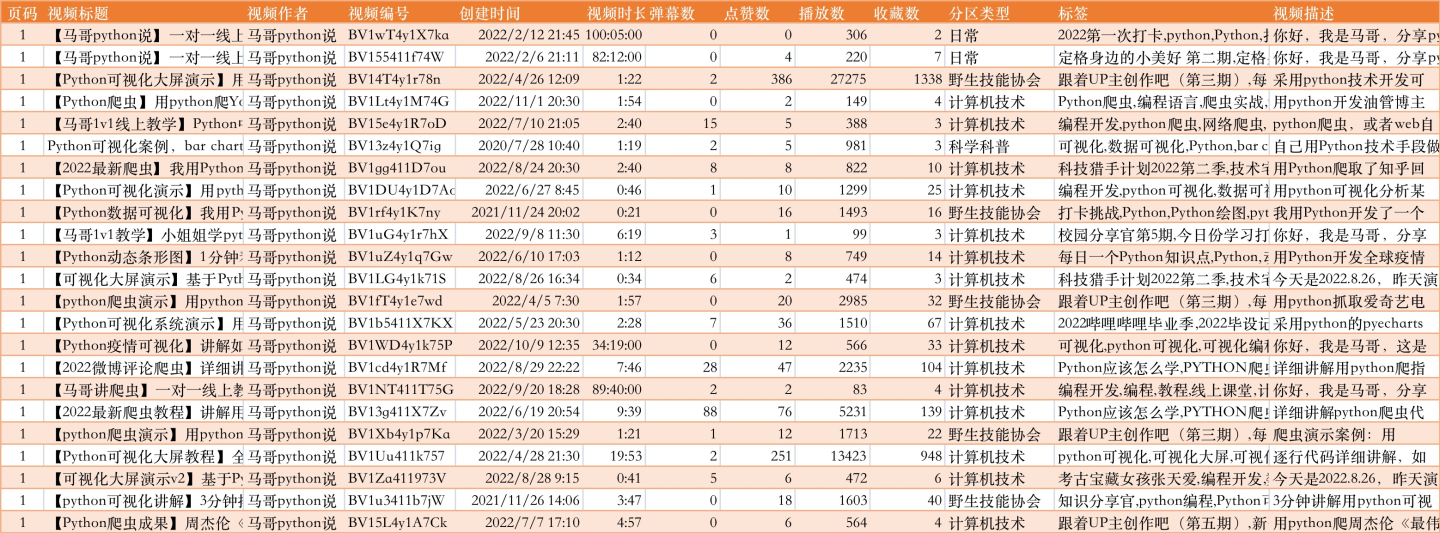

页码, 视频标题, 视频作者, 视频编号, 创建时间, 视频时长, 弹幕数, 点赞数, 播放数, 收藏数, 分区类型, 标签, 视频描述

部分爬取结果:

这里,我一共爬了30页,每页30条,共30*30=900条数据(当然,最大爬取页数可自定义放大)

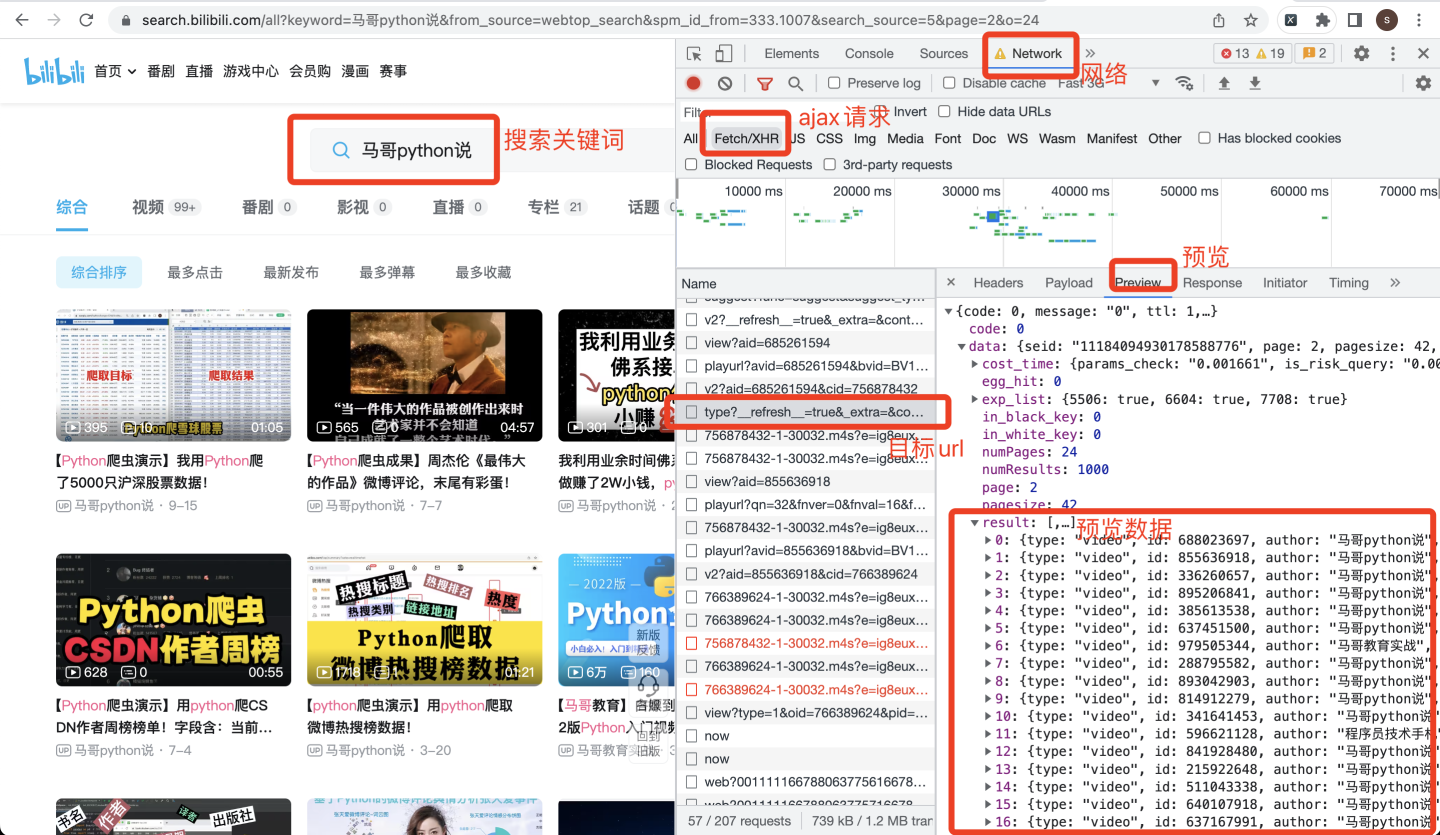

下面,开始分析网页。

打开开发者模式,在页面搜索关键词,并进行翻页一次,如下:

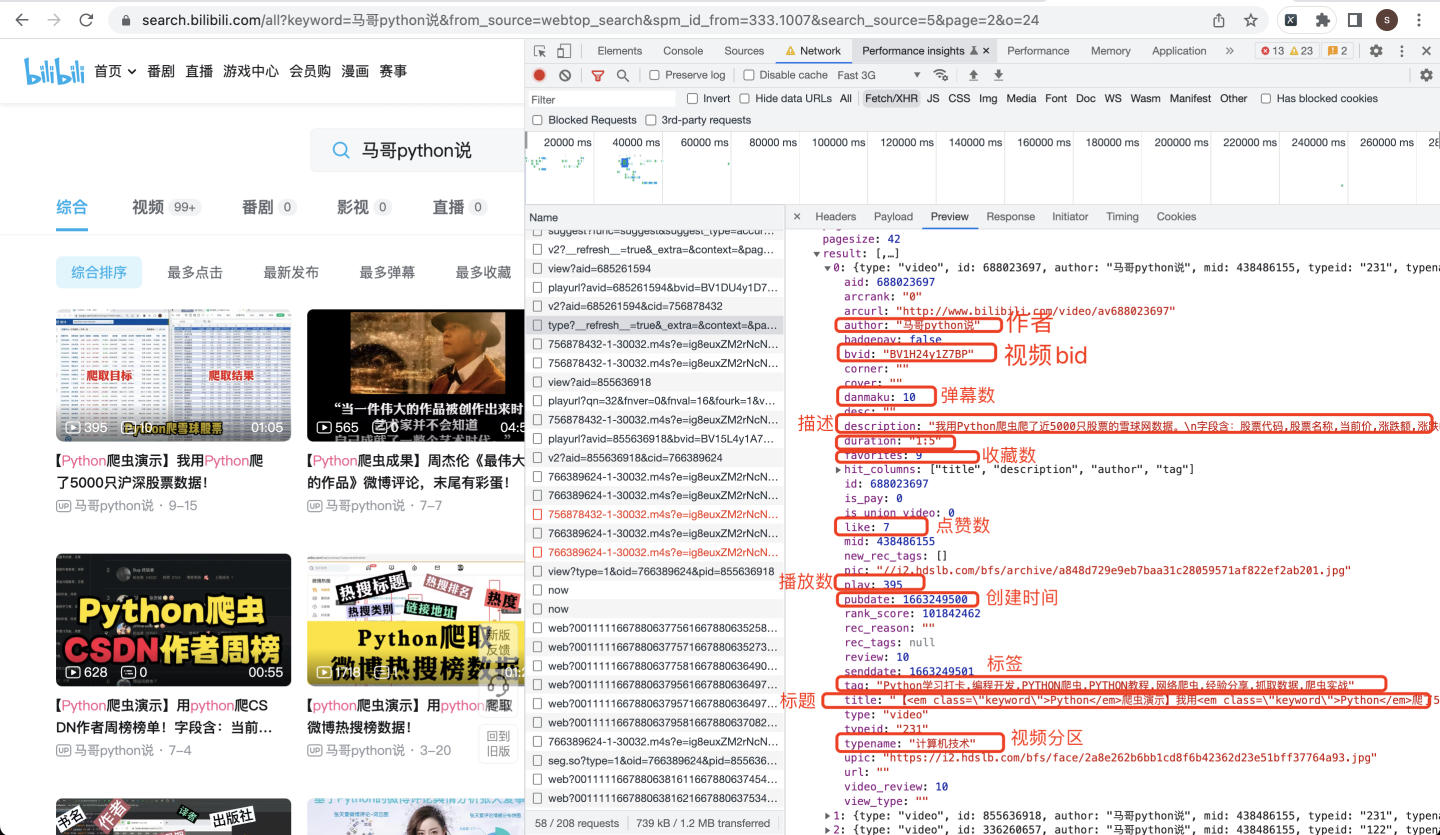

看到了result节点中的列表数据,就是我们要找到的视频数据,依次查看每个具体数据:

json数据

分析到这里,就可以开发爬虫了。

二、讲解代码

首先,导入用到的库:

import requests # 发送请求

import time # 获取时间

import os

import pandas as pd # 保存csv数据

import re # 数据清洗

下面,开始发送请求。

请求地址在哪获取呢?

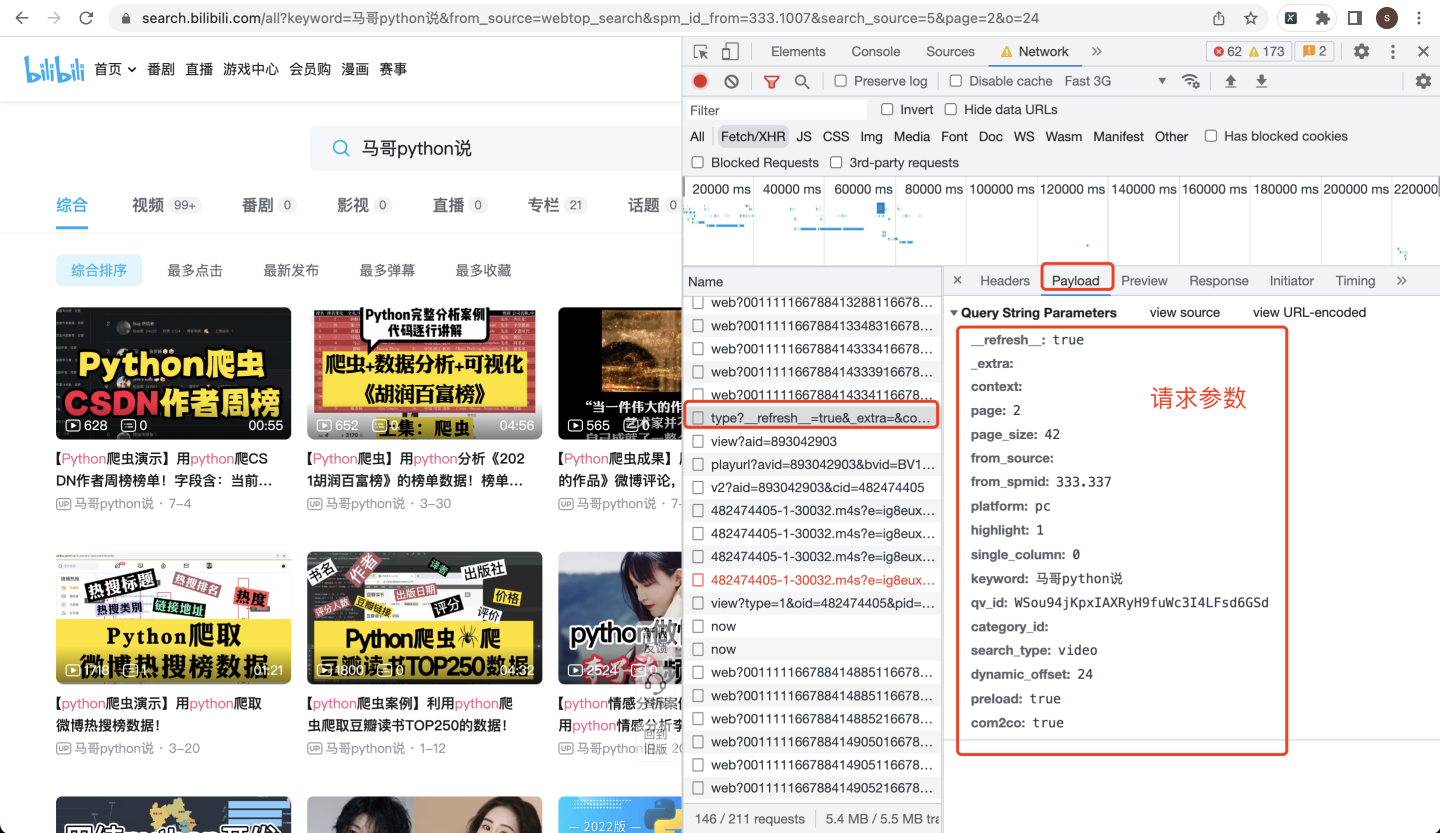

请求参数在Payload里面:

请求参数代码:

# 请求参数

params = {

'__refresh__': 'true',

'_extra': '',

'context': '',

'page': page,

'page_size': 30,

'from_source': '',

'from_spmid': '333.337',

'platform': 'pc',

'highlight': '1',

'single_column': '0',

'keyword': v_keyword,

'qv_id': 'dHavr2spEK3TphPa54klZ6svdhBYOlyP',

'category_id': '',

'search_type': 'video',

'dynamic_offset': 24,

'preload': 'true',

'com2co': 'true',

}

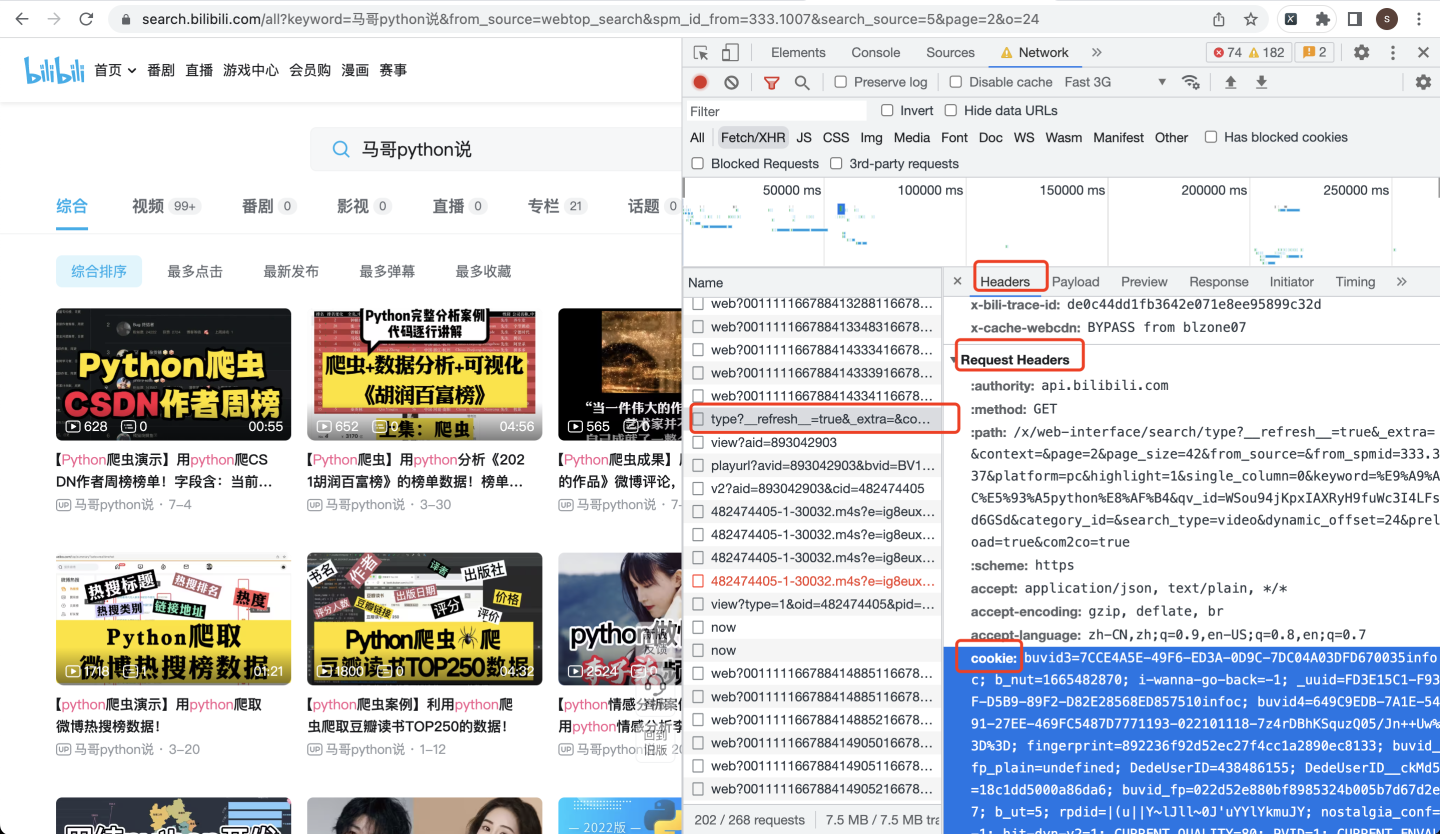

请求头,在Request Headers里面:

注意!cookie很重要,如果不传入cookie这个参数,会返回412错误码!

请求头代码:

# 请求头

headers = {'accept': 'application/json, text/plain, */*',

'accept-encoding': 'gzip, deflate, br',

'accept-language': 'zh-CN,zh;q=0.9,en-US;q=0.8,en;q=0.7',

# cookie必需,否则返回412

'cookie': "换成自己的cookie",

'origin': 'https://search.bilibili.com',

'referer': 'https://search.bilibili.com/all?keyword={}&from_source=webtop_search&spm_id_from=333.1007&search_source=5&page=2&o=24'.format(

v_keyword),

'sec-ch-ua': '"Google Chrome";v="107", "Chromium";v="107", "Not=A?Brand";v="24"',

'sec-ch-ua-mobile': '?0',

'sec-ch-ua-platform ': '"macOS"',

'sec-fetch-dest': 'empty',

'sec-fetch-mode': 'cors',

'sec-fetch-site': 'same-site',

'user-agent': 'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/107.0.0.0 Safari/537.36'

}

发送请求:

# 向页面发送请求

r = requests.get(url, headers=headers, params=params)

print(r.status_code) # 查看响应码

解析出result列表数据:

data_list = j_data['data']['result']

print('数据长度:', len(data_list))

定义空列表,并for循环追加数据,以视频标题title为例:

for data in data_list:

title = re.compile(r'<[^>]+>', re.S).sub('', data['title']) # 正则表达式清洗文本

print('视频标题: ' + title)

title_list.append(title)

其他字段同理,不再赘述。

最后通过pandas的to_csv,保存最终数据。

# 数据保存到csv文件

df.to_csv(v_out_file, encoding='utf_8_sig', mode='a+', index=False, header=header)

to_csv的时候需加上选项(encoding='utf_8_sig'),否则存入数据会产生乱码,尤其是windows用户!

三、同步讲解视频

https://www.zhihu.com/zvideo/1573636442722697216

四、完整源码

附完整源码:点击此处完整源码

原创作者: 马哥python说 持续分享python干货中!