spark与Scala安装过程和步骤及sparkshell命令的使用

Spark与Scala版本兼容问题:

Spark运行在Java 8 +,Python 2.7 + / 3.4 +和R 3.1+上。对于Scala API,Spark 2.4.2使用Scala 2.12。您需要使用兼容的Scala版本(2.12.x)。

请注意,自Spark 2.2.0起,对2.6.5之前的Java 7,Python 2.6和旧Hadoop版本的支持已被删除。自2.3.0起,对Scala 2.10的支持被删除。自Spark 2.4.1起,对Scala 2.11的支持已被弃用,将在Spark 3.0中删除。

https://spark.apache.org/docs/latest/index.html

1.官网下载安装Scala:scala-2.12.8.tgz

https://www.scala-lang.org/download/

2.将Scala解压到/opt/module目录下

tar -zxvf scala-2.12.8.tgz -C /opt/module

3.将scala-2.12.8改成Scala

mv scala-2.12.8 scala

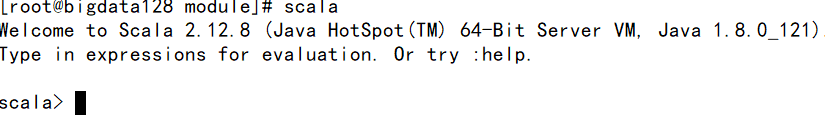

4.测试scala是否安装成功

测试:scala -version

5.启动Scala命令:scala

1.官网下载安装Spark:spark-2.4.2-bin-hadoop2.7.tgz

https://www.apache.org/dyn/closer.lua/spark/spark-2.4.2/spark-2.4.2-bin-hadoop2.7.tgz

2.解压、重命名

ar -zxvf spark-2.4.2-bin-hadoop2.7.tgz -C /opt/module

mv spark-2.4.2-bin-hadoop2.7.tgz spark

3.配置环境变量

export SPARK_HOME=/opt/module/spark

export PATH=$PATH:$SPARK_HOME/bin #

使环境变量生效 :source /etc/profile

4.启动spark

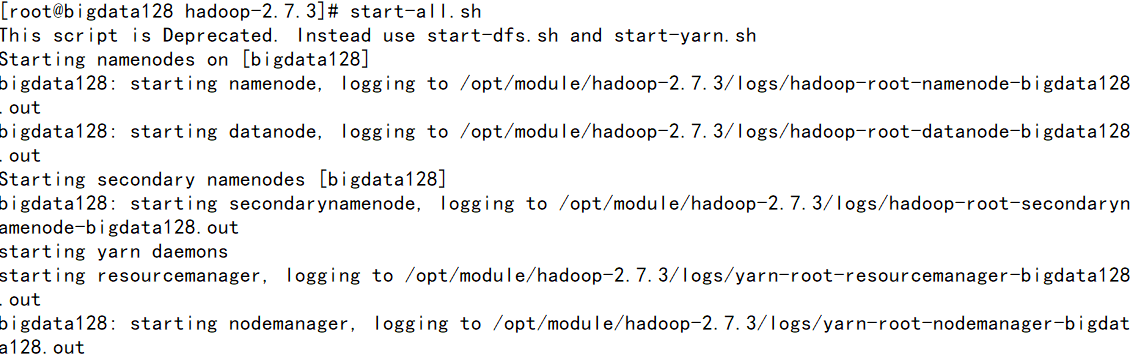

①先启动hadoop 环境

start-all.sh

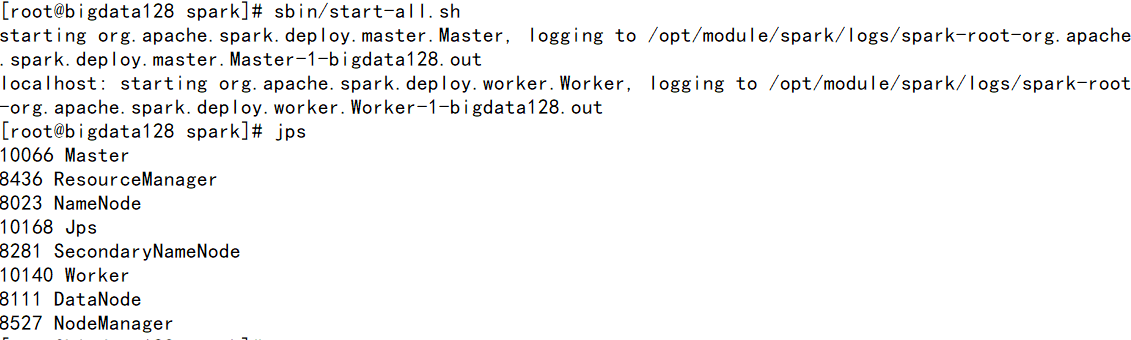

②启动spark环境

进入到SPARK_HOME/sbin下运行start-all.sh

[注] 如果使用start-all.sh时候会重复启动hadoop配置,需要./在当前工作目录下执行命令

jps 观察进程 多出 worker 和 mater 两个进程。

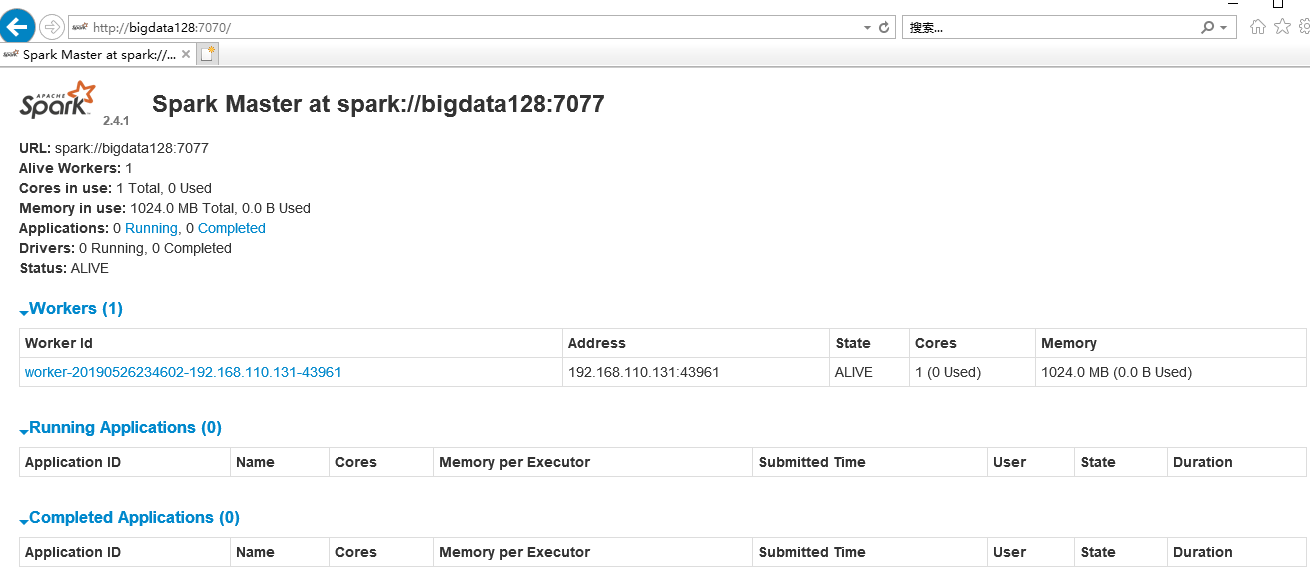

5.查看spark的web控制页面:http://bigdata128:7077/

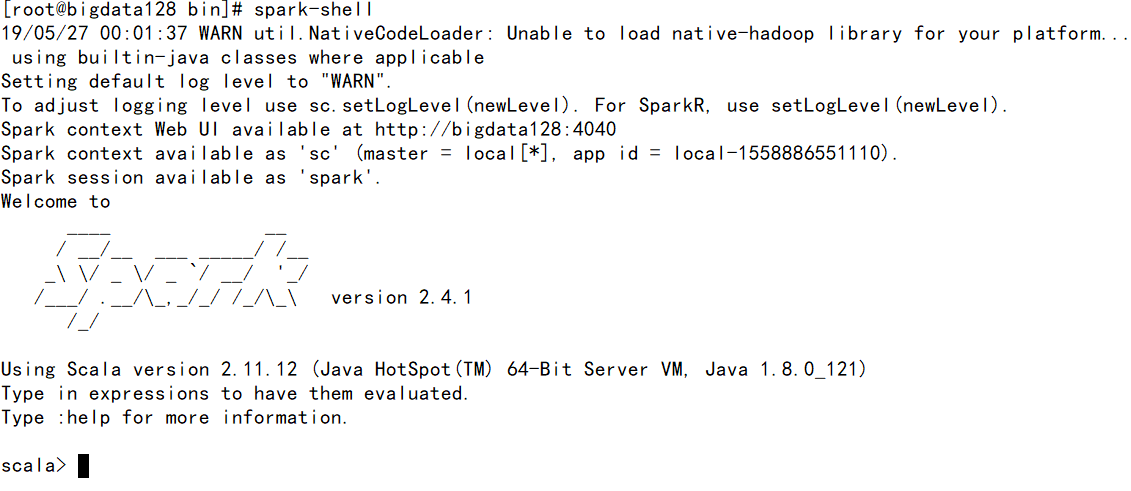

使用Spark-shell命令

此模式用于interactive programming,先进入bin文件夹后运行:spark-shell

浙公网安备 33010602011771号

浙公网安备 33010602011771号