论文翻译:2018_Speech Bandwidth Extension Using Generative Adversarial Networks

论文地址:基于生成对抗网络的语音频带扩展

博客作者(引用请指明出处):https://www.cnblogs.com/LXP-Never/p/10121897.html

摘要

语音盲带宽扩展技术已经出现了一段时间,但到目前为止还没有出现广泛的部署,部分原因是增加的带宽伴随着附加的工件。本文提出了三代盲带宽扩展技术,从矢量量化映射到高斯混合模型,再到基于生成对抗性网络的深层神经网络的最新体系结构。这种最新的方法在质量上有了很大的提高,并证明了基于机器学习的盲带宽扩展算法在客观上和主观上都能达到与宽带编解码器相当的质量。我们相信,盲带宽扩展现在可以达到足够高的质量,以保证在现有的电信网络中部署。

关键词:盲源带宽扩展,人工带宽扩展,生成对抗性网络,客观质量评价,主观质量评价,POLQA

一、引言

直到几年前,语音通信的质量一直受到100多年前的设计选择的限制,这导致了8 kHz采样率实际频率使用范围为300-3400 Hz。这种所谓的窄带(NB)频率范围严重限制了语音质量。最近业界已开始转向“高清声音”和“超高清声音”技术,它们分别使用宽带(WB)或超宽带(SWB)编码器,使得采样率分别为16 kHz或32 kHz映射成50-7000 Hz或50-14000 Hz的频率范围[1][2]。

然而,WB和SWB部署并不普遍,因为需要大量的成本去开发、测试、和部署支持的服务。此外,端到端的WB/SWB呼叫需要在两端升级设备.要达到全面覆盖和手机普及率,可能需要数年的时间,而将固定电话网络升级到WB/SWB可能需要更长的时间。在此之前,很大一部分呼叫仍将使用遗留窄带。

盲源带宽扩展(BBE)技术就是通过将NB语音转换为WB或SWB语音来解决这个问题。在本文中为了简单我们将只关注于WB的情况。

二、背景

2.1 相关工作

已经提出了各种盲源频带扩展的统计方法,从语音0~4kHz的低频部分(LB)预测4~8kHz的高频部分(HB)。通常,使用某种形式的谱折叠或统计建模来产生具有宽带语音[3][4]一般特征的信号。虽然不能期望完美的预测,但可以获得合理的高质量的语音。

矢量量化(VQ)码本映射可以用来创建语音参数从LB到HB[5][6]的离散映射。基于高斯混合模型(GMM)的方法,通过对语音包络参数的连续建模,用来保存了LB到HB之间更加精确的转换。隐马尔可夫模型(HMM)通过利用语音时态信息来扩展GMMs[8]。基于神经网络的盲源频带扩展方法,如深神经网络,已经被提出,因为它们可以对高度非线性问题进行更好的建模[9]。

2.2 损失函数(Loss)与GANs

本文所讨论的统计模型都是基于回归问题中最基本的损失函数——均方误差(MSE),它测量了HB语音包络特征在预测值和真实值之间的差异。MSE损失函数在一般意义上工作良好,但难以处理恢复缺失语音HB时固有的不确定性,如详细的频谱形状和浊音/清音能量。最小化MSE会发现看似真实的参数平均值,这就是典型的过拟合,因而具有较差的感知质量。

GANs已在[10]中引入,并已成功地应用于图像处理领域,如图像到图像的转化[11]、图像的超分辨率[12]和文本到图像的合成[13]。GAN训练阶段重建向高概率搜索空间的区域移动,高概率搜索空间包含真实HB语音参数分布,从而接近自然语音HB波形[12]。在这篇文章中,我们研究了GANs在盲源频带扩展上面是如何训练的。

三、盲源频带扩展的框架

一般情况下,盲源频带扩展框架是建立在经典的源滤波器语音产生模型的基础上的。利用该模型,窄带语音信号的宽带扩展可分为两个子任务:

- 高频谱包络的估计

- 窄带激励信号的扩展

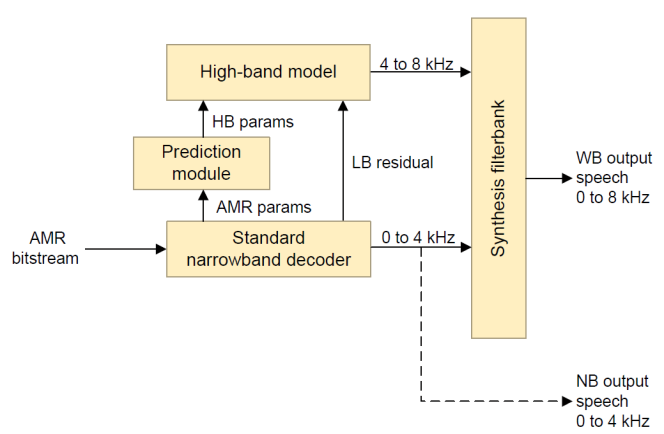

为了合成高频语音信号,我们利用EVRC-WB[14]中的高带宽模型。下图显示了我们的盲源频带扩展框架的总体图。

3.1 High-band(高频带)激励

HB(高频带)激励是由NB(窄带)激励通过一个非线性函数产生的,该函数产生保持信号harmonic(谐波)结构的高频段激励[14]。

3.2 High-band(高频带)谱包络

在我们的语音High-band(高频带)扩展模型中,对于每20ms的语音帧,使用6th-order Line Spectral Frequencies(六阶线谱频率)(LSF)对High-band(高频带)进行spectrally shape(频谱塑形),并且使用对应于LB(低频带)和High-band(高频带)能量的增益因子[14]。

3.3 框架验证

该BBE框架经过测试,客观地和主观地验证了从原始WB语音中提取HB参数时,其质量不会低于AMR-WB 12.65 kbps。因为BBE通常不会到达AMRWB 12.65 kbps质量,框架不存在性能瓶颈。该框架也用于EVRC-WB,以及高通专有的eAMR WB编解码器[16]。

四、HB(高频带)参数预测

4.1 语音参数

| 输入 | 输出 |

| 10th order low-band LSFs + Delta LSFs |

6th order high-band LSFs |

| 0-4 kHz speech energy | 4-8kHz语音能量 |

表一:预测器输入输出参数

在我们的High-band(高频带)预测实验中使用的参数如表1所示。在不需要额外的延迟的情况下,LB LSFs的后向deltas(增量)用于改进预测。

4.2.最小均方误差的统计建模

4.2.1.VQ码本映射

最基本的方法是码本映射。从宽带语音中提取LB和HB语音包络参数,并进一步使用诸如k-means的聚类方法来训练VQ码本。在估计阶段,将接收到的窄带参数与码本中的LB包络参数进行比较,然后选择最接近接收到的窄带包络参数的项。所选项对应的HB包络参数用作HB谱包络参数[5]。在实践中,最近的码本条目被插值,由它们的LB包络参数和接收到的窄带包络参数之间的距离加权[6]。

4.2.2.高斯混合模型(GMM)

与码本映射相比,GMM可以连续地对语音包络数据进行建模,从而实现软聚类。采用期望最大化(EM)和最大似然估计(MLE)[7]进行训练。该概率框架在训练过程中引入状态转移概率矩阵,将模型转化为GMM/HMM混合模型,从而灵活地融合了语音时域信息。增加隐马尔可夫(HMM)分量的主要好处在于它可以隐式地利用先前语音帧中的信息来提高估计精度[8]。文[7]详细讨论了利用混合方法和协方差矩阵,从LB参数到HB参数的变形技术。

4.3.用GANs进行统计建模

4.3.1.生成对抗性网络框架

图二: BBE-GAN 框架

GAN[10]包括生成器(G)和鉴别器(D),如图2所示。这里,对于我们的BBE-GAN系统,G是一个深度神经网络,它根据LB参数预测HB参数。D是另一种作为二进制分类器的深度神经网络,它试图区分预测的HB参数和natural(自然)HB语音参数。

在对抗训练中,G试图通过调整其权重和偏置项来愚弄D,从而使D相信它的输出是natural(自然)的。D和G被反复训练,它们都试图击败对方。这种方法可以生成与自然数据分布相同的输出,因此可以生成更自然的语音。

4.3.2 使用MSE Loss进行Pre-traing(预训练)

深神经网络已经被应用于BBE问题,在[9]中使用了MSE Loss。例如在[9]中。我们以这样一个模型作为出发点。在此,利用标准MSE损失对HB LSFs和能量的四层DNN生成器进行了预处理。为了使GAN训练过程有一个好的初始生成器开始,预训练是至关重要的,这有助于避免不稳定的问题。

4.3.3 perceptual(知觉)Loss函数

感知Loss函数$l$的定义对生成器网络的性能起着至关重要的作用。在SRGAN[12]中的感知Loss函数设计的启发下,我们将HB语音包络参数$l{params}$与对抗网络的Loss$l_{adv}$结合起来,将感知Loss作为他们的加权和,如式(1)所示。

$$l = l_{params}+10^{-2}*l_{adv}$$

5. 实验

5.1 开始

我们以NTT 1994多语言语料库[17]作为训练和验证数据,采用10-fold cross10 validation(10倍交叉验证)方案,进行了语音带宽扩展实验。数据以16 kHz采样率进行采样,数字化为16位分辨率,采用ITU-T P.341兼容滤波器模拟典型的Tx电话响应。我们使用ITU-T P.501英式英语[18]作为评估数据集。

对于BBE-VQ,我们使用单独的256个元素的VQ码本来实现HB LSFs和Gain(增益),预测采用三个最接近的候选项的加权组合。

对于BBE-GMM,我们使用了一个GMM-HMM混合模型,该混合模型有64个状态,每个状态有4个混合状态,并且具有完全的协方差矩阵。该算法采用Viterbi译码算法的前向路径,不需要提前时延。

对于BBE-GAN,生成器和鉴别器都是四层前馈DNN(1层输入层、1层输出层、2层隐层),每个隐层有1024个神经元,在训练过程中使用ADAM优化器。

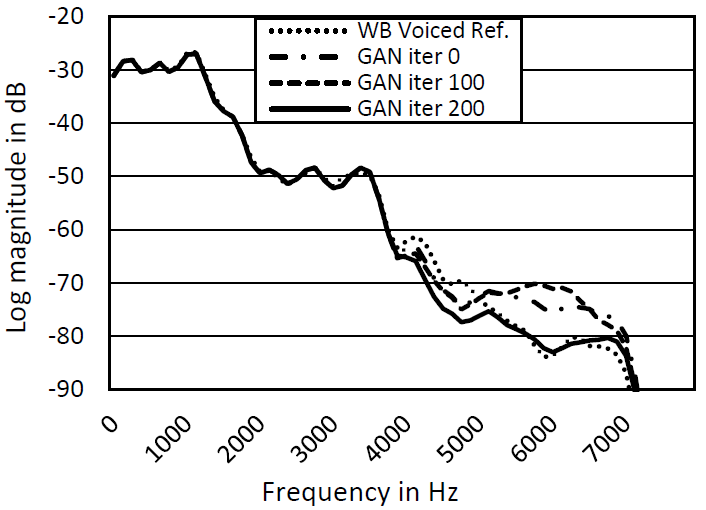

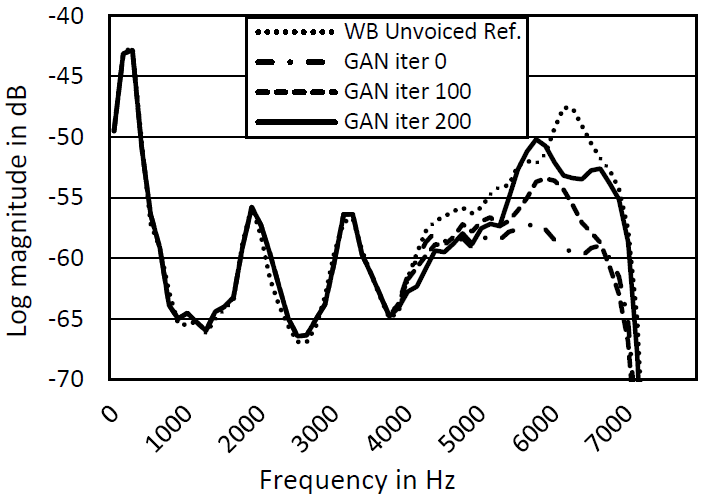

图3和图4显示了在第0、100和200次的迭代对抗训练过程中典型浊音段和清音段的频谱包络。我们可以清楚地看到,随着损失函数的远离MSE,BBE-GAN输出正朝着参考WB语音的频谱方向移动。GAN训练过程可以提高清音段的能量,同时清除浊音段中不必要的HB噪声。这导致了语音质量的显著提高,具有更少的声音伪影和更高的自然度。

图3:浊音输出与GAN迭代

图4:清音输出与GAN迭代

5.2 客观表现

对于客观评价,我们遵循[19]中描述的方法,并在ITU-T P Suppl.27[20]。为了满足带宽需求,我们以ITU-T P.501英式英语语料数据库作为输入,分别测量了3 GPP RX掩码[21]各自的的Rx频率响应。在语音质量方面,我们用AMR 12.2kbps编码的P.501英式英语测试了BBE输出的POLQA[22]得分值。

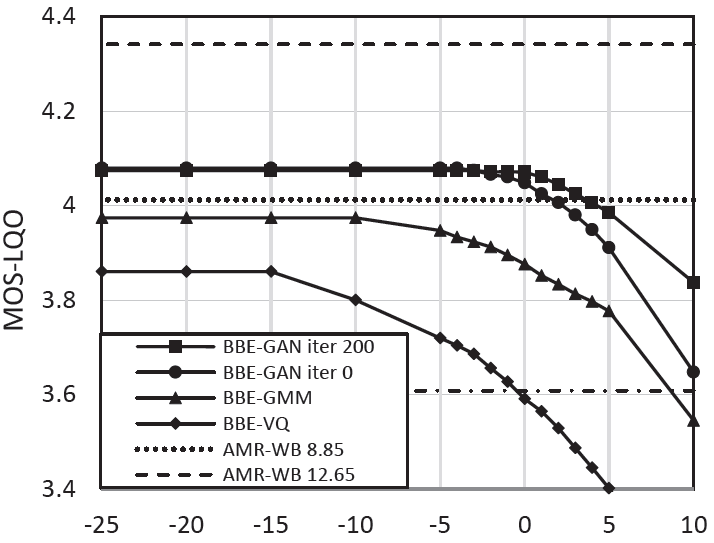

把我们之前讨论的BBE算法的POLQA分数绘制成曲线,12.65kbps作为参考,AMR-NB在12.2kbps和AMR-WB分别在8.85kbps和12.65kbps的得分值作为参考。结果如图5所示,其中0dB表示响应遵循掩码的下限。从BBE-VQ到BBE-GMM再到BBE-GAN都有明显的改进,显示所使用的统计模型的建模能力不断增强。在迭代0次的GAN和迭代200次的GAN(完全训练过的)之间,最大POLQA值是相似的,但是在更高带宽的情况下,BBE-GAN在迭代200时的POLQA得分更好。这个预测结果是一个比较好的指示,使得通过完全训练好的GAN来减少伪影子的数量成为可能。

HB相对于3 GPP WB Rx掩码的水平,以dB为单位

图5:POLQA MOS-LQO vs Bandwidth

5.3.主观表现

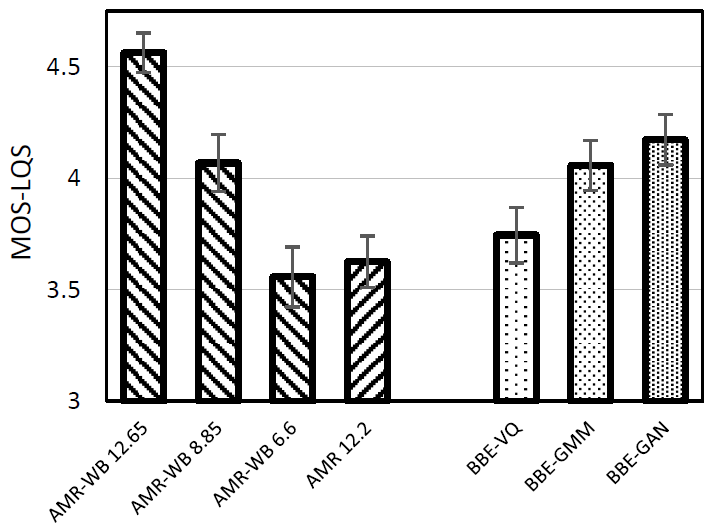

采用ITU-T-P.800方法对本文提出的各种BBE算法的主观性能进行了评价.一个退化等级(DCR)[23]测试是在一个独立的测试实验室进行的。测试使用了32个听众、42个语音和每个语音下192张选票。DCR测试的结果如图6所示,误差条表示95%的置信区间。得分与图5所示的客观结果一致。

图6:P.800 DCR MOS-LQS at 3GPP mask level

保持了BBE(盲源频带扩展)算法的rank-order(阶次),BBE-GAN在统计上相当于AMR-WB的8.85 kbps。很多BBE-VQ和BBE-GMM的测试结果都可以在[19]中找到(其中它们分别对应于算法BBE3和BBE4)。

More testing results can be found for BBE-VQ and BBE-GMM in [19] (where they respectively correspond to algorithms BBE3 and BBE4).

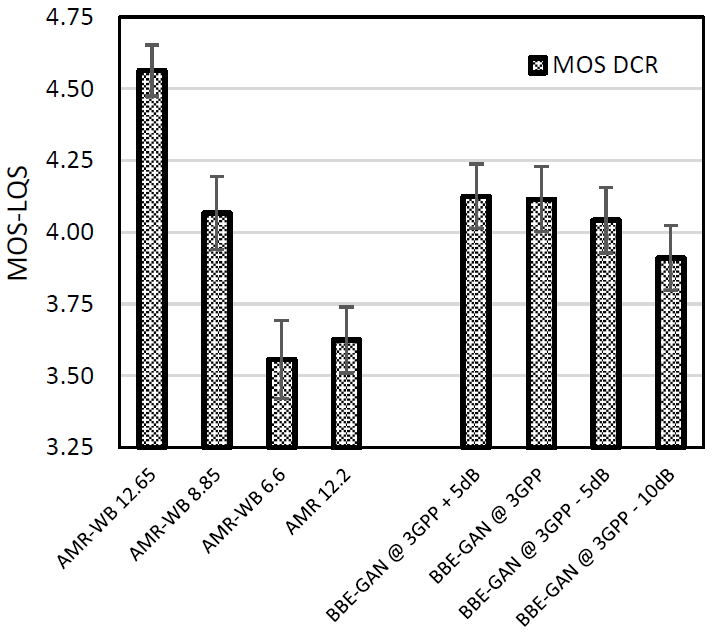

5.4 High-band(高频带)衰减与主观质量

我们对BBE-GAN的训练用了几个滤波器,相对于3GPP WB Rx mask(掩模),将HB level(水平)从+5dB调整到-10dB。图7显示了这些条件下的P.800 DCR评分。注意,如图5所示,该级别相对于掩码下限制,因此-5dB表示低于掩码下限的响应,而+5dB表示掩码的上限和下限之间的响应。

图7:DCR MOS vs bandwidth

我们观察到,如图5所示的客观度量结果所预测的那样,BBE-GAN即使在更高的带宽水平上也能保持性能。这也说明了在带宽和质量上GAN盲源频带扩展与WB编解码器完全可以相媲美,并再次证实了客观评价与主观评价结果的一致性[19][20]。

六、结论

本文提出了三代盲带宽扩展技术,从VQ到GMM再到GAN。我们发现,与经典的统计建模技术相比,像GAN这样的机器学习技术在质量上有了显著的提高。基于GAN的预测可以使盲源频带扩展的质量与WB编解码器相类似,实现了与AMR-WB 8.85 kbps质量相当的客观和主观性能。虽然盲源频带扩展技术已经研究了很多年,但由于它不能提供与宽带编解码器类似的质量,所以还没有得到广泛的应用。我们已经表明,使用GAN等机器学习技术可以达到这一质量水平,这有可能加快电信网络中广泛采用盲源频带扩展BBE的速度。

七、参考文献

[1] 3GPP TS 26.190, “Adaptive multi-rate wideband (AMR-WB) speech codec; Transcoding functions,” 3rd Generation Partnership Project, Sept. 2012, version 11.0.0.

[2] 3GPP TS 26.441, “Codec for Enhanced Voice Services (EVS); General overview,” 3rd Generation Partnership Project, Dec. 2015, version 13.0.0.

[3] H. Carl and U. Heute, “Bandwidth enhancement of narrowband speech signals,” in Proc. EUSIPCO, vol. 2, Edinburgh, UK, Sept. 1994, pp. 1178–1181.

[4] H. Pulakka and P. Alku, “Bandwidth extension of telephone speech using a neural network and a filter bank implementation for highband mel spectrum,” IEEE Trans. Audio, Speech, Language Process., vol. 19, no. 7, pp. 2170–2183, Sept. 2011.

[5] Y. Qian and P. Kabal, “Wideband speech recovery from narrowband speech using Classified codebook mapping”, Proceedings of the 9th Australian International Conference on Speech Science & Technology Melbourne, Dec. 2002.

[6] J. Epps and W. H. Holmes, “A new technique for wideband enhancement of coded narrowband speech,” in Proc. IEEE Speech Coding Workshop, 1999, pp. 174–176.

[7] K.-Y. Park and H. S. Kim, “Narrowband to wideband conversion of speech using GMM based transformation,” in Proc. ICASSP 2000, pp.1843–1846.

[8] P. Jax and P. Vary, “Artificial bandwidth extension of speech signals using MMSE estimation based on a Hidden Markov model,” in Proc. ICASSP 2003, pp. 680-683.

[9] Y. Wang, S. Zhao, W. Liu, M. Li, J. Kuang, “Speech bandwidth expansion based on Deep Neural Networks,” in Proc. INTERSPEECH 2015, pp. 2593-2597.

[10] I. Goodfellow, J. Pouget-Abadie, M. Mirza, B. Xu, D. Warde- Farley, S. Ozair, A. Courville, and Y. Bengio. “Generative adversarial nets,” in Advances in Neural Information Processing Systems (NIPS), pages 2672–2680, 2014.

[11] P. Isola, J. Zhu, T. Zhou, A. A. Efros, “Image-to-Image Translation with Conditional Adversarial Networks,” arXiv:1611.07004.

[12] C. Ledig, et al. “Photo-Realistic Single Image Super- Resolution Using a Generative Adversarial Network,” arXiv:1609.04802.

[13] H. Zhang, et al. “StackGAN: Text to Photo-realistic Image Synthesis with Stacked Generative Adversarial Networks,” arXiv:1616.03242.

[14] 3GPP2 C.S0014-C v1.0 “Enhanced Variable Rate Codec, Speech Service Option 3, 68 and 70 for Wideband Spread Spectrum Digital Systems”.

[15] 3GPP TS 26.090, “Adaptive multi-rate (AMR) speech codec; Transcoding functions,” 3rd Generation Partnership Project, Sept. 2012, version 11.0.0.

[16] S. Villette, S. Li, P. Ramadas, D. Sinder, “eAMR: Wideband speech over legacy narrowband networks,” in Proc. ICASSP 2017, pp. 5110-5114.

[17] N. A. T. Corporation, “Multi-lingual speech database for telephonometry,” http://www.nttat. com/products e/speech, 1994.

[18] ITU-T P.501, “Test signals for use in telephonometry,” Int. Telecommunication. Union, Jan. 2012.

[19] S.Villette, S. Li, P. Ramadas, D. Sinder, “An Objective Evaluation Methodology for Blind Bandwidth Extension,” in Proc. INTERSPEECH 2016, pp 2548-2552.

[20] ITU-T P Suppl. 27, “Application of ITU-T P.863 and ITU-T P.863.1 for speech processed by blind bandwidth extension approaches,” Int. Telecomm. Union, Geneva, 2017.

[21] 3GPP TS 26.131, “Terminal acoustic characteristics for telephony; Requirements,” 3rd Generation Partnership Project, Dec. 2015, version 13.2.0.

[22] ITU-T Rec. P.863, “Perceptual Objective Listening Quality Assessment,” Int. Telecomm. Union, Geneva, 2011.

[23] ITU-T P.800, “Methods for subjective determination of transmission quality,” Int. Telecommunication Union, Aug. 1996.